Google apresenta nova geração de TPUs para turbinar inteligência artificial e competir com a Nvidia

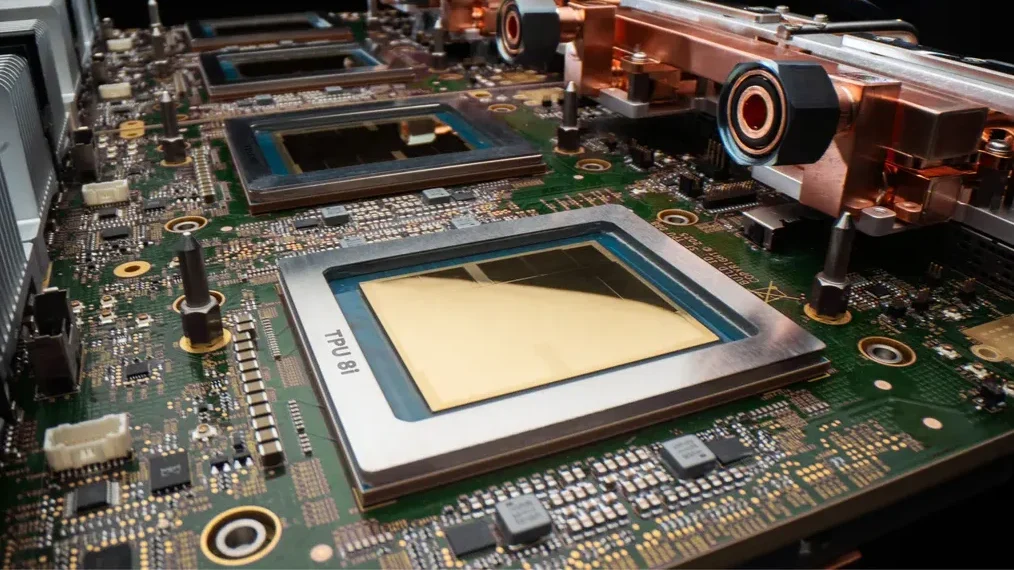

Em um movimento estratégico para consolidar sua liderança no campo da inteligência artificial, o Google anunciou a oitava geração de suas Unidades de Processamento Tensorial (TPUs). Os novos chips, batizados de TPU 8t e TPU 8i, foram revelados durante o evento Google Cloud Next e chegam com a promessa de revolucionar o treinamento e a inferência de modelos de IA na nuvem. Essa inovação visa não apenas atender à crescente demanda por sistemas de IA mais avançados, mas também intensificar a disputa com a gigante Nvidia no mercado de hardware especializado.

A principal novidade desta geração é a divisão do hardware em duas unidades distintas, cada uma focada em otimizar uma etapa crucial do desenvolvimento e aplicação da inteligência artificial. Essa abordagem visa aprimorar a eficiência, reduzir custos e preparar a infraestrutura de nuvem do Google para a era dos agentes autônomos, sistemas de IA capazes de operar com maior independência.

Segundo informações divulgadas pelo Google, a nova linha de TPUs estará disponível no mercado ainda este ano, com desenvolvimento que contou com forte participação do laboratório Google DeepMind. O objetivo é garantir que o hardware seja compatível com as ferramentas de código aberto mais utilizadas pelos desenvolvedores, facilitando sua adoção e impulsionando a inovação no ecossistema de IA.

TPU 8t e 8i: Otimização para Treinamento e Inferência

A separação em duas unidades de processamento atende a necessidades distintas da inteligência artificial. O TPU 8t foi projetado para a fase de treinamento, que demanda um poder computacional massivo para processar grandes volumes de dados. O Google afirma que o TPU 8t oferece 2,8 vezes mais poder de processamento que a geração anterior, mantendo a mesma faixa de preço, o que garante escalabilidade e estabilidade nas operações de treinamento.

Por outro lado, o TPU 8i foca na inferência, que é a aplicação prática da IA, onde a velocidade de resposta e a baixa latência são cruciais para atender a milhões de usuários simultaneamente. Este chip conta com 288 GB de memória ultrarrápida integrada e opera em conjunto com as novas CPUs Axion do Google. A empresa garante um desempenho 80% maior por dólar investido, o que se traduz em maior eficiência para os clientes que utilizam os serviços de nuvem do Google.

Redução de Custos e Eficiência Energética

A divisão estratégica dos chips TPU 8t e 8i tem como objetivo principal a redução do gasto de energia e do custo operacional dos servidores. Sundar Pichai, CEO da Alphabet, explicou que essa arquitetura permite que múltiplos agentes de IA trabalhem em equipe de forma mais eficiente, entregando respostas rápidas e otimizando o uso dos recursos computacionais.

Essa otimização é fundamental para o Google Cloud, que busca oferecer soluções de IA cada vez mais competitivas e acessíveis. Ao fortalecer suas próprias TPUs, a empresa visa reter clientes, controlar margens de lucro e ter maior autonomia no desenvolvimento de sua infraestrutura de inteligência artificial, diminuindo a dependência de fornecedores externos como a Nvidia.

Demanda Garantida e Potencial de Mercado Bilionário

Mesmo antes de seu lançamento oficial, a oitava geração de TPUs já demonstra um forte potencial de mercado. O Google revela que parceiros importantes, como a startup Anthropic e laboratórios de pesquisa vinculados ao Departamento de Energia dos Estados Unidos, já se comprometeram a utilizar os novos chips. Esse interesse inicial valida a estratégia do Google em investir em hardware especializado para IA.

Analistas da DA Davidson estimam que a divisão de negócios de TPUs do Google, em conjunto com as operações do laboratório DeepMind, já representa um valor de mercado colossal, próximo a US$ 900 bilhões. Esse número reforça a importância estratégica e o potencial financeiro do desenvolvimento de hardware próprio para inteligência artificial.